AIGC动态欢迎阅读

吧”

关键字:弱智,模型,嘉宾,峰会,性能文章来源:量子位

内容字数:4492字内容摘要:

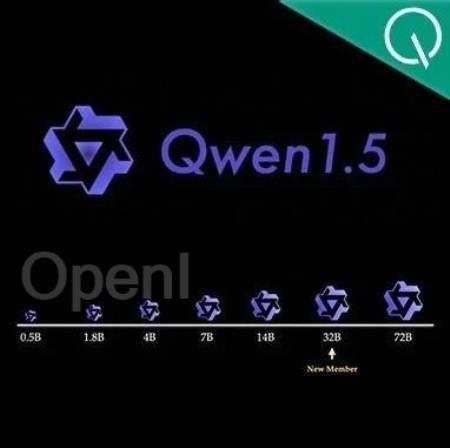

金磊 发自 凹非寺量子位 | 公众号 QbitAI阿里的通义千问(Qwen),终于拼齐了1.5系列的最后一块拼图——

正式开源Qwen 1.5-32B。

话不多说,直接来看“成绩单”。

这次官方pick同台竞技的“选手”是Mixtral 8x7B模型和同为Qwen 1.5系列的72B模型。

从结果上来看,Qwen 1.5-32B已经在多项评测标准中超越或追平Mixtral 8x7B:

并且即便是在与自家更大参数模型PK过程中,Qwen 1.5-32B也用“以小博大”的姿势展现出了较好的性能。

用通义千问团队成员的话来说就是:

这个模型显示出了与72B模型相当的性能,特别是在语言理解、多语言支持、编码和数学能力等方面。

在推理和部署过程中,成本还会更加友好。

不仅如此,即便是再拉来其它体量相当的大模型“选手”,Qwen 1.5-32B在多项评测中的成绩依旧较为亮眼:

除此之外,团队还做了一项比较有意思的测试——长文本评估任务,“大海捞针”。

简单来说,这项任务就是将一个与文本无关的句子(“针”)隐藏在大量的文本(“大海”)中,然后通过自然语言提问的方式,观察AI能否准确提取出这个隐藏的句联系作者

文章来源:量子位

作者微信:QbitAI

作者简介:追踪人工智能新趋势,关注科技行业新突破