AIGC动态欢迎阅读

价值自对齐,比GPT4更「体贴」

关键字:社会,模型,价值观,问题,自我文章来源:机器之心

内容字数:7985字内容摘要:

机器之心专栏

机器之心编辑部随着大语言模型(LLMs)在近年来取得显著进展,它们的能力日益增强,进而引发了一个关键的问题:如何确保他们与人类价值观对齐,从而避免潜在的社会负面影响?

模型如 ChatGPT依赖于基于人类反馈的强化学习(RLHF),这一方法通过鼓励标注者偏好的回答并惩罚不受欢迎的反馈,提出了一种解决方案。然而,RLHF 面临着成本高昂、难以优化等问题,以及在超人类水平模型面前显得力不从心。为了减少乃至消除对人类监督的依赖,Anthropic 推出了 Constitutional AI,旨在要求语言模型在回答时遵循一系列人类规则。同时,OpenAI的研究通过采用弱模型监督强模型的方法,为超人类水平模型的对齐提供了新的视角。尽管如此,由于用户给出的指令千变万化,将一套固定的社会规则应用于 LLMs 显得不够灵活;而且,弱模型对强模型的监督提升效果尚不明显。

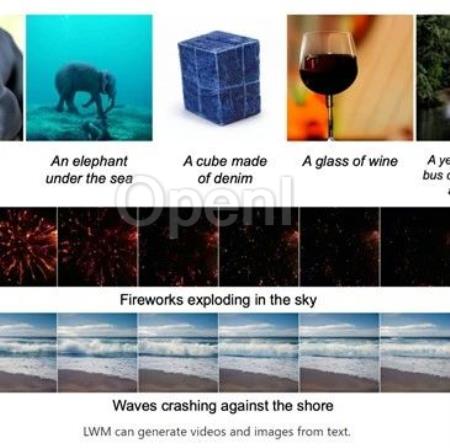

为了解决这些大语言模型价值对齐的挑战,上海交通大学、上海人工智能实验室的科研团队发表了新工作《Self-Alignment of Large Language Models via Monopolylogue-base原文链接:MATRIX:社会模拟推动大模型价值自对齐,比GPT4更「体贴」

联系作者

文章来源:机器之心

作者微信:almosthuman2014

作者简介:专业的人工智能媒体和产业服务平台