AIGC动态欢迎阅读

原标题:数量即力量!腾讯揭秘:Agent数量越多,大语言模型

效果越好

关键字:腾讯,性能,任务,方法,模型

文章来源:机器之心

内容字数:4327字内容摘要:

机器之心专栏

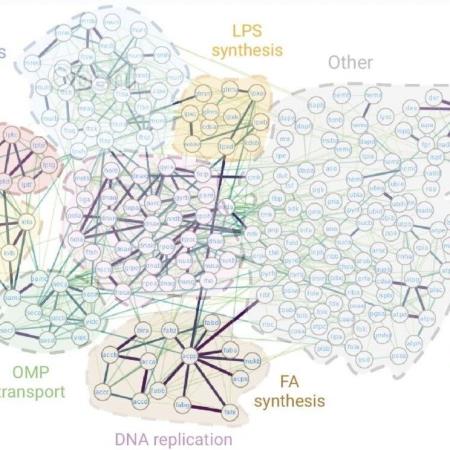

机器之心编辑部来自腾讯的研究者们做了一个关于 agent 的scaling property(可拓展性)的工作。发现:通过简单的采样投票,大语言模型(LLM)的性能,会随着实例化agent数量的增加而增强。其第一次在广泛的场景下验证了该现象的普遍性,与其他复杂方法的正交性,以及研究了其背后的原因,并提出进一步促成scaling发挥威力的办法。论文标题:More Agents Is All You Need

论文地址:https://arxiv.org/abs/2402.05120

代码地址:https://github.com/MoreAgentsIsAllYouNeed/More-Agents-Is-All-You-Need

本文中,来自腾讯的研究者发现:只需通过一种简单的采样投票法,大语言模型的性能就会随着实例化 agent 的数量的增大而增强,呈现scaling property(可拓展性),无需复杂的多 LLM agents 协作框架以及prompt工程方法的加持。此外,该方法与现有的复杂方法正交,结合之后,可进一步增强 LLM,其增强程度与任务难度相关。该论文做原文链接:数量即力量!腾讯揭秘:Agent数量越多,大语言模型效果越好

联系作者

文章来源:机器之心

作者微信:almosthuman2014

作者简介:专业的人工智能媒体和产业服务平台