AIGC动态欢迎阅读

原标题:揭秘AI幻觉:GPT-4

V存在视觉编码漏洞,清华联合NUS提出LLaVA-UHD

关键字:图像,报告,切片,分辨率,模型文章来源:机器之心

内容字数:6364字内容摘要:

机器之心专栏

机器之心编辑部GPT-4V 的推出引爆了多模态大模型的研究。GPT-4V 在包括多模态问答、推理、交互在内的多个领域都展现了出色的能力,成为如今最领先的多模态大模型。

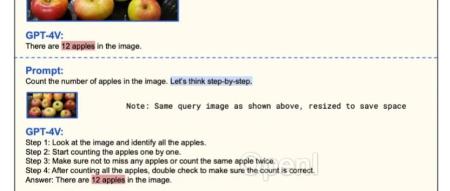

然而,近期很多工作发现 GPT-4V 在很多基本能力上却意外的出现短板。例如,在微软一篇长达 166 页的技术报告《The Dawn of LMMs:Preliminary Explorations with GPT-4V (ision)》中,作者发现,对于一个不太复杂的图像中的苹果数量,GPT-4V 竟然怎么数也数不对。然而,学术界和工业界尚不清楚导致这些问题的底层原因。

这个问题在清华大学、新加坡国立大学和中国科学院大学的一篇题为《LLaVA-UHD: an LMM Perceiving Any Aspect Ratio and High-Resolution Images》的论文中得到了解释。论文链接:https://arxiv.org/pdf/2403.11703.pdf

项目链接:github.com/thunlp/LLaVA-UHD

其原因在于 GPT-4V 很可能存在:视觉编码漏洞。

该工作对原文链接:揭秘AI幻觉:GPT-4V存在视觉编码漏洞,清华联合NUS提出LLaVA-UHD

联系作者

文章来源:机器之心

作者微信:almosthuman2014

作者简介:专业的人工智能媒体和产业服务平台